A pneumonia coloca um milhão de americanos adultos no hospital a cada ano e mata 50.000. Se um médico suspeitar que um paciente tem pneumonia, ele geralmente pedirá uma radiografia de tórax. Esses raios X devem ser interpretados por um médico, é claro. Mas agora, os pesquisadores de Stanford desenvolveram um algoritmo que, segundo eles, pode diagnosticar melhor a pneumonia em raios X do que radiologistas experientes.

"A vantagem de um algoritmo é que ele pode aprender com centenas de milhares de radiografias de tórax e seus diagnósticos correspondentes de outros especialistas", diz Pranav Rajpurkar, um estudante de pós-graduação do Stanford Machine Learning Group, que liderou a pesquisa. "Quando os radiologistas têm a chance de aprender com centenas de milhares de diagnósticos de outros radiologistas e encontrar padrões nas imagens que levam a esses diagnósticos?"

O algoritmo, chamado CheXNet, também pode diagnosticar outras 13 condições médicas, incluindo enfisema e pneumotórax (ar preso entre o pulmão e a parede torácica). A equipe construiu o algoritmo usando um conjunto de dados público do National Institutes of Health (NIH), que continha mais de 100.000 imagens de radiografia de tórax marcadas com 14 possíveis condições. O conjunto de dados foi lançado juntamente com um algoritmo de diagnóstico inicial, que o NIH encorajou outros pesquisadores a avançar.

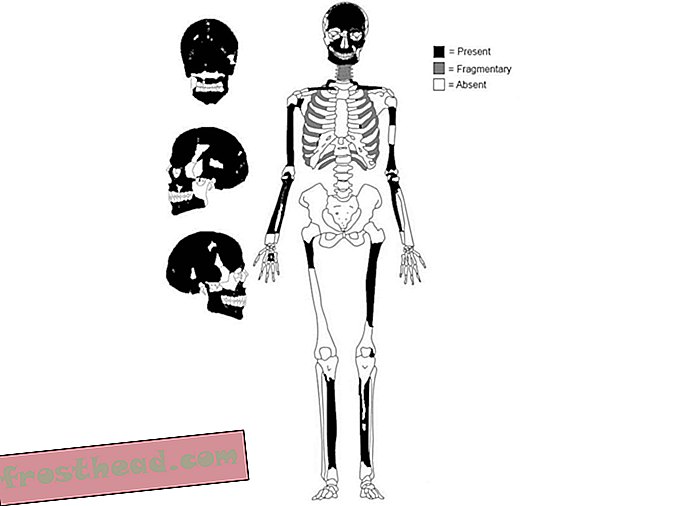

Rajpurkar e seus colegas membros do Machine Learning Group decidiram aceitar o desafio. Os pesquisadores fizeram quatro radiologistas de Stanford marcarem possíveis indicações de pneumonia em 420 das imagens. Usando esses dados, dentro de uma semana eles criaram um algoritmo que poderia diagnosticar com precisão 10 condições. Dentro de um mês, o algoritmo poderia superar os algoritmos anteriores no diagnóstico de todas as 14 condições. Neste ponto, os diagnósticos de CheXNet concordaram com uma opinião de maioria de radiologistas mais muitas vezes do que uma opinião individual de qualquer um radiologista.

A pesquisa foi publicada este mês no arXiv site de pré-impressão científica.

Outros algoritmos de diagnóstico fizeram as notícias recentemente. Equipes canadenses e italianas desenvolveram algoritmos para diagnosticar a doença de Alzheimer a partir de exames cerebrais. A distribuição das placas no cérebro que caracterizam a doença é muito sutil a olho nu, mas os pesquisadores dizem que a tecnologia AI pode detectar padrões anormais. Rajpurkar e seus colegas pesquisadores do Machine Learning Group de Stanford também desenvolveram um algoritmo para diagnosticar arritmias cardíacas, analisando horas de dados de monitores cardíacos vestíveis. Outros algoritmos de pneumonia foram desenvolvidos a partir dos dados do NIH, mas o de Stanford é até agora o mais preciso.

O CheXNet pode ser especialmente útil em lugares onde as pessoas não têm acesso fácil a radiologistas experientes, diz a equipe. Também pode ser útil como uma espécie de triagem, identificando quais casos provavelmente precisam de atenção de emergência e quais não precisam. A equipe também desenvolveu uma ferramenta que produz um mapa de possíveis indicadores de pneumonia em raios-X, oferecendo um guia visual útil para os médicos.

Enquanto a equipe está otimista sobre as habilidades de diagnóstico da CheXNet, eles são cautelosos sobre seus limites.

“A IA é uma ferramenta poderosa, mas são necessários anos de experiência e muitas horas difíceis para intuir como usá-la, e é igualmente difícil determinar onde podemos usá-la para o impacto mais positivo”, afirma Rajpurkar.

Embora existam vários algoritmos de aprendizagem profunda em desenvolvimento, nenhum deles ainda passou pelo rigoroso processo de teste e aprovação necessário para uso em pacientes reais.

Paul Chang, professor de radiologia e vice-presidente do departamento de radiologia da Universidade de Chicago, fala com ceticismo sobre o CheXNet e programas similares de aprendizagem profunda. Os médicos já usam algoritmos para ajudar no diagnóstico de qualquer número de condições, diz Chang. Esses algoritmos dependem de um modelo pré-formado de como a condição se parece: os cânceres são maiores e mais espinhosos do que as massas benignas, por exemplo. Em contraste, os programas de aprendizado profundo destinam-se a descobrir quais recursos são significativos por conta própria, processando enormes quantidades de dados. Mas isso também significa que eles podem pegar as pistas erradas. Chang dá o exemplo de um algoritmo de aprendizado profundo que aprendeu a diferença entre vários tipos de raios X: mãos, pés, mamografias. Mas os pesquisadores descobriram que o programa simplesmente aprendeu a reconhecer as mamografias pelo fato de que a imagem principal estava do lado do filme, e não no centro (já que os seios estão presos à parede do tórax que aparecem na borda do filme). mamografia, em contraste, as mãos ou os pés aparecerão no centro do raio X). O algoritmo não estava aprendendo nada significativo sobre seios, apenas sobre sua posição na tela.

"Isso é muito cedo", diz Chang, que aponta que os resultados do CheXNet não foram revisados por pares. “A aprendizagem profunda tem um grande potencial, mas nós, na medicina e na radiologia, costumamos estar no início do ciclo de hype, mas isso nos leva mais tempo a adotar. Nós aprenderemos como consumi-lo apropriadamente. ”